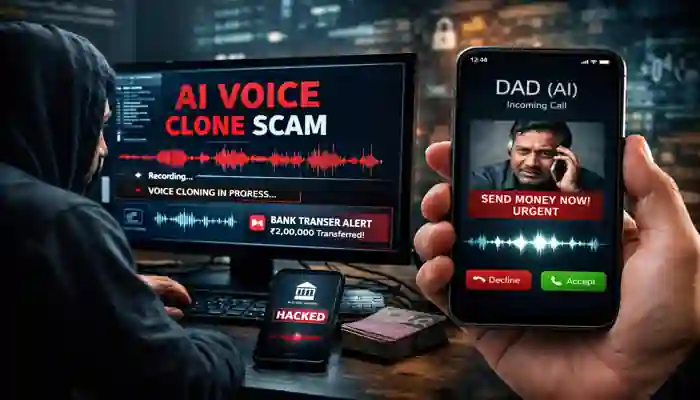

2026 में साइबर अपराध का एक नया और बेहद खतरनाक तरीका सामने आया है — AI Voice Clone Scam। इस स्कैम में ठग किसी व्यक्ति की सिर्फ 20–30 सेकंड की आवाज रिकॉर्ड करके उसे AI की मदद से क्लोन कर लेते हैं। इसके बाद उसी आवाज में कॉल करके परिवार, दोस्तों या बैंक से जुड़े लोगों को धोखा दिया जाता है।

डिजिटल इंडिया के दौर में जहां लोग ऑनलाइन बैंकिंग, UPI और डिजिटल पेमेंट पर निर्भर हैं, वहीं साइबर अपराधी भी Artificial Intelligence (AI) का इस्तेमाल कर नए तरीके से लोगों को निशाना बना रहे हैं।

विशेषज्ञों के अनुसार, आने वाले समय में AI Voice Cloning Fraud भारत में सबसे तेजी से बढ़ने वाले साइबर अपराधों में शामिल हो सकता है।

Background: AI Voice Cloning क्या है?

AI Voice Cloning एक ऐसी तकनीक है जिसमें Artificial Intelligence और Deep Learning का उपयोग करके किसी व्यक्ति की आवाज की हूबहू नकल बनाई जाती है।

यह तकनीक मूल रूप से फिल्मों, ऑडियो बुक्स, गेमिंग और वॉइस असिस्टेंट के लिए बनाई गई थी, लेकिन अब साइबर अपराधी इसका गलत इस्तेमाल कर रहे हैं।

AI मॉडल को अगर किसी व्यक्ति की 20–30 सेकंड की आवाज मिल जाए तो वह उस आवाज का डिजिटल मॉडल बना सकता है।

इसके बाद AI उस व्यक्ति की तरह ही बोल सकता है, जिससे पहचान करना लगभग असंभव हो जाता है।

2026 में तेजी से बढ़ रहे AI Voice Scam

2026 में कई साइबर सिक्योरिटी रिपोर्ट्स में बताया गया है कि AI आधारित फ्रॉड में पिछले साल के मुकाबले कई गुना वृद्धि हुई है।

भारत में बढ़ते डिजिटल लेनदेन के कारण ठग अब फोन कॉल और व्हाट्सएप वॉइस मैसेज के जरिए लोगों को निशाना बना रहे हैं।

सबसे ज्यादा टारगेट किए जाने वाले लोग:

- बिजनेस ओनर

- बैंक अकाउंट होल्डर

- UPI यूजर

- वरिष्ठ नागरिक

- कंपनी के कर्मचारी

AI Voice Clone Scam कैसे काम करता है

यह स्कैम आमतौर पर कई स्टेप में होता है।

1. आवाज रिकॉर्ड करना

ठग सबसे पहले किसी व्यक्ति की आवाज रिकॉर्ड करते हैं।

यह आवाज उन्हें मिल सकती है:

- सोशल मीडिया वीडियो

- यूट्यूब वीडियो

- व्हाट्सएप वॉइस मैसेज

- फोन कॉल रिकॉर्डिंग

2. AI से Voice Clone बनाना

इसके बाद उस आवाज को AI Voice Cloning Software में डाला जाता है।

कुछ ही मिनट में AI उस व्यक्ति की आवाज का डिजिटल क्लोन तैयार कर देता है।

3. नकली कॉल करना

अब ठग उसी क्लोन आवाज में कॉल करते हैं।

जैसे:

“मुझे तुरंत पैसे की जरूरत है, अभी ट्रांसफर कर दो।”

आवाज असली जैसी होने के कारण लोग आसानी से भरोसा कर लेते हैं।

4. पैसे ट्रांसफर करवाना

ठग आमतौर पर UPI, बैंक ट्रांसफर या गिफ्ट कार्ड के जरिए पैसे मंगवाते हैं।

एक बार पैसे भेजने के बाद उन्हें वापस पाना बहुत मुश्किल होता है।

Verified Data: साइबर फ्रॉड के आंकड़े

साइबर सिक्योरिटी विशेषज्ञों के अनुसार:

- AI आधारित फ्रॉड 2026 में तेजी से बढ़ रहा है

- Voice cloning scams में हर साल बड़ी वृद्धि हो रही है

- सोशल मीडिया से आवाज चुराना सबसे आसान तरीका बन गया है

- कई कंपनियां अब AI fraud detection सिस्टम पर काम कर रही हैं

Real Life Scam Example

मान लीजिए किसी व्यक्ति ने अपने बेटे की आवाज का वीडियो Instagram या YouTube पर पोस्ट किया।

ठग उस वीडियो से आवाज निकाल लेते हैं और AI से उसे क्लोन कर लेते हैं।

इसके बाद वे पिता को कॉल करते हैं:

“पापा मैं मुसीबत में हूं, तुरंत पैसे भेजो।”

आवाज बिल्कुल असली जैसी लगती है, इसलिए कई लोग तुरंत पैसे भेज देते हैं।

Timeline: AI Voice Clone Scam का विकास

2022

AI Voice Cloning तकनीक तेजी से विकसित हुई।

2023

कुछ देशों में Voice Cloning Fraud के मामले सामने आने लगे।

2024

Deepfake और AI fraud के मामले बढ़ने लगे।

2025

कई कंपनियों ने AI आधारित fraud detection शुरू किया।

2026

भारत में AI Voice Clone Scam को लेकर चेतावनी जारी होने लगी।

Expert Insights

साइबर सिक्योरिटी विशेषज्ञों का कहना है कि आने वाले समय में AI Deepfake Voice Fraud और भी ज्यादा खतरनाक हो सकता है।

विशेषज्ञों के अनुसार:

- केवल आवाज के आधार पर किसी पर भरोसा न करें

- पैसों से जुड़ी बातों को हमेशा दोबारा सत्यापित करें

- वीडियो कॉल या मैसेज के जरिए पुष्टि करें

Government और Cyber Security Agencies की चेतावनी

भारत की साइबर सुरक्षा एजेंसियां लोगों को लगातार सतर्क रहने की सलाह दे रही हैं।

सुझाव दिए गए हैं:

- अनजान कॉल पर भरोसा न करें

- तुरंत पैसे ट्रांसफर न करें

- किसी भी संदिग्ध कॉल की शिकायत करें

भारत में साइबर अपराध की शिकायत Cyber Crime Portal पर की जा सकती है।

Global vs India: दुनिया में क्या स्थिति है

AI Voice Cloning Scam सिर्फ भारत में ही नहीं बल्कि कई देशों में तेजी से फैल रहा है।

कुछ देशों में कंपनियों को भी निशाना बनाया गया है जहां ठगों ने CEO की आवाज क्लोन करके करोड़ों का ट्रांसफर करवा लिया।

भारत में डिजिटल पेमेंट के तेजी से बढ़ने के कारण यह खतरा और भी बढ़ सकता है।

इससे कैसे बचें

AI Voice Clone Scam से बचने के लिए कुछ जरूरी सावधानियां अपनानी चाहिए।

1. तुरंत पैसे ट्रांसफर न करें

अगर कोई कॉल करके पैसे मांगता है तो तुरंत पैसे न भेजें।

2. पहचान की पुष्टि करें

हमेशा दूसरे नंबर पर कॉल करके पहचान की पुष्टि करें।

3. वीडियो कॉल करें

जरूरी मामलों में वीडियो कॉल करके बात करें।

4. सोशल मीडिया पर सावधानी रखें

अपनी आवाज वाले वीडियो कम शेयर करें।

5. बैंक अलर्ट एक्टिव रखें

बैंक SMS और ईमेल अलर्ट हमेशा चालू रखें।

Future Impact: आने वाले समय में खतरा

AI तकनीक तेजी से विकसित हो रही है।

आने वाले समय में:

- Deepfake Video Scam बढ़ सकते हैं

- Voice cloning और realistic हो सकता है

- बैंक सुरक्षा सिस्टम को और मजबूत करना पड़ेगा

Cyber security विशेषज्ञों का मानना है कि AI fraud आने वाले वर्षों में सबसे बड़ा डिजिटल खतरा बन सकता है।

Public Reactions

सोशल मीडिया पर लोग AI voice cloning को लेकर चिंता जता रहे हैं।

कई लोगों का कहना है कि अब फोन कॉल पर भरोसा करना भी मुश्किल हो सकता है।

साथ ही कई टेक कंपनियां AI misuse को रोकने के लिए नए सिस्टम विकसित कर रही हैं।

FAQs

1. AI Voice Cloning क्या होता है?

AI Voice Cloning एक तकनीक है जिसमें Artificial Intelligence किसी व्यक्ति की आवाज की बिल्कुल समान कॉपी बना सकता है।

2. क्या सिर्फ 30 सेकंड की आवाज से क्लोन बन सकता है?

हाँ, कई AI टूल्स 20–30 सेकंड की आवाज से भी Voice Clone बना सकते हैं।

3. AI Voice Scam से कैसे बचें?

किसी भी कॉल पर तुरंत पैसे ट्रांसफर न करें और हमेशा पहचान की पुष्टि करें।

4. अगर AI Scam हो जाए तो क्या करें?

तुरंत बैंक को सूचित करें और Cyber Crime Portal पर शिकायत दर्ज करें।

Conclusion

AI Voice Clone Scam 2026 में उभरता हुआ एक बड़ा साइबर खतरा बनता जा रहा है। सिर्फ कुछ सेकंड की आवाज का इस्तेमाल करके ठग किसी भी व्यक्ति की आवाज की नकल कर सकते हैं और लोगों को धोखा दे सकते हैं।

डिजिटल युग में जहां तकनीक हमारे जीवन को आसान बना रही है, वहीं इसका गलत इस्तेमाल भी तेजी से बढ़ रहा है। इसलिए जरूरी है कि लोग AI आधारित फ्रॉड के प्रति जागरूक रहें और सावधानी बरतें।

सतर्कता ही इस नए डिजिटल खतरे से बचने का सबसे बड़ा हथियार है।